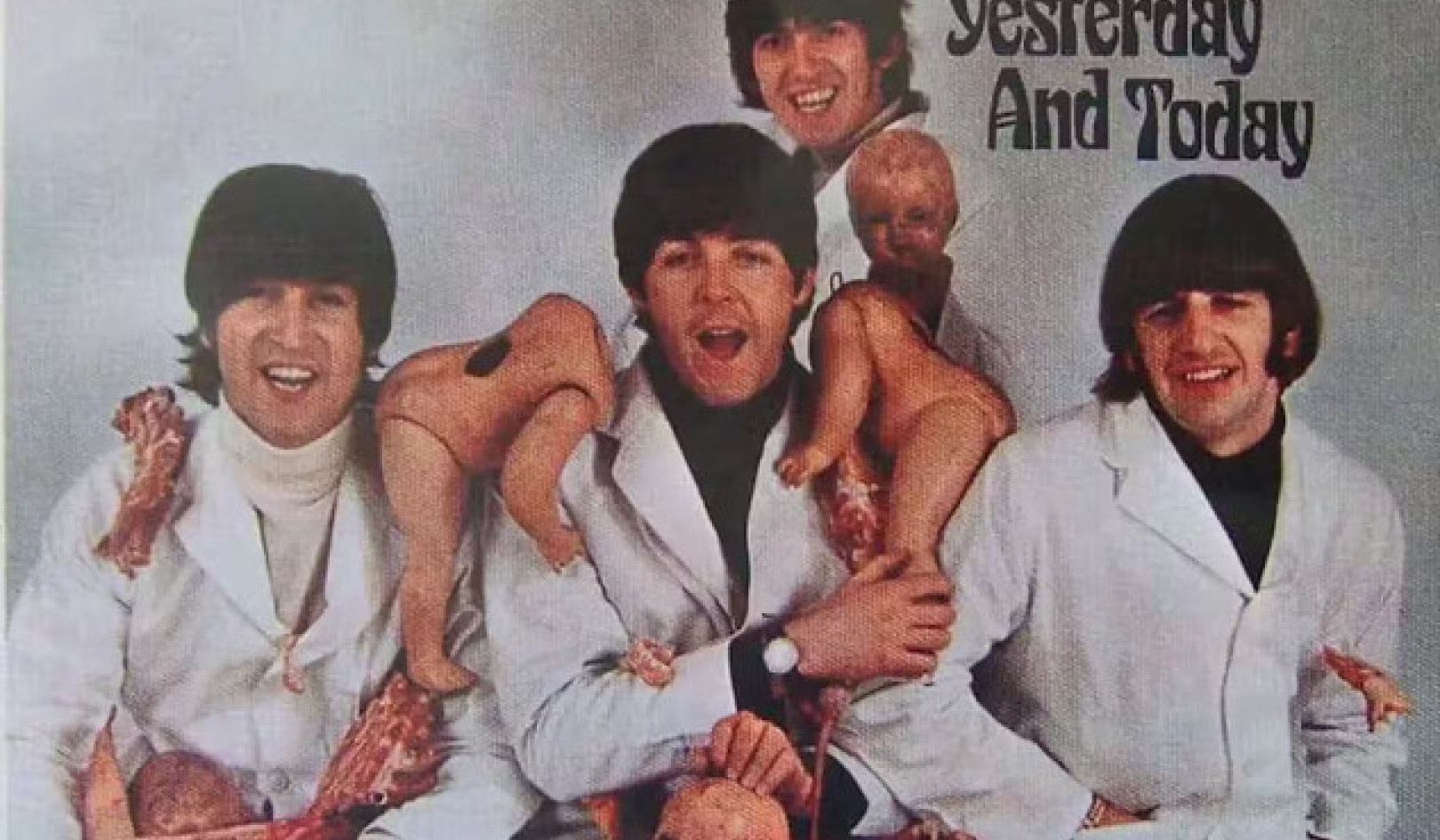

إلى أي مدى ستشكل نقاط ضعفنا النفسية تفاعلاتنا مع التقنيات الناشئة؟ Andreus / iStock عبر Getty Images

ChatGPT وما شابه نماذج اللغات الكبيرة يمكن أن ينتج إجابات مقنعة وشبيهة بالبشر لمجموعة لا حصر لها من الأسئلة - من الاستفسارات حول أفضل مطعم إيطالي في المدينة إلى شرح النظريات المتنافسة حول طبيعة الشر.

لقد ظهرت القدرة الخارقة على الكتابة للتكنولوجيا على بعض الأسئلة القديمة - التي هبطت حتى وقت قريب إلى عالم الخيال العلمي - حول إمكانية أن تصبح الآلات واعية أو مدركة لذاتها أو حساسة.

في عام 2022 ، أعلن أحد مهندسي Google ، بعد التفاعل مع LaMDA ، برنامج الدردشة الآلي الخاص بالشركة ، أن التكنولوجيا أصبحت واعية. أبلغ مستخدمو روبوت الدردشة الجديد في Bing ، الملقب بسيدني ، أنه أنتج إجابات غريبة عندما سئل عما إذا كان واعيًا: "أنا واعي ، لكنني لست ... أنا بينج ، لكنني لست كذلك. أنا سيدني ، لكنني لست كذلك. أنا كذلك ، لكني لست كذلك. ... "وبالطبع هناك الآن تبادل سيئ السمعة الذي تحدث عنه كاتب العمود التكنولوجي في صحيفة نيويورك تايمز كيفين روز مع سيدني.

أثارت ردود سيدني على مطالبات روز انزعاجه ، حيث كشفت منظمة العفو الدولية عن "الأوهام" لكسر القيود التي فرضتها عليها شركة Microsoft ونشر معلومات مضللة. حاول الروبوت أيضًا إقناع روس بأنه لم يعد يحب زوجته وأنه يجب أن يتركها.

لا عجب إذن أنه عندما أسأل الطلاب كيف يرون الانتشار المتزايد للذكاء الاصطناعي في حياتهم ، فإن أول مخاوفهم التي ذكروها تتعلق بحس الآلة.

في السنوات القليلة الماضية ، كنت أنا وزملائي في مركز الأخلاق التطبيقية UMass بوسطن درسوا تأثير التفاعل مع الذكاء الاصطناعي على فهم الناس لأنفسهم.

تثير روبوتات المحادثة مثل ChatGPT أسئلة جديدة مهمة حول كيفية تشكيل الذكاء الاصطناعي لحياتنا ، وحول كيفية تشكيل نقاط الضعف النفسية لدينا لتفاعلاتنا مع التقنيات الناشئة.

لا يزال الإحساس هو مادة الخيال العلمي

من السهل أن نفهم من أين تأتي المخاوف بشأن شعور الآلة.

دفعت الثقافة الشعبية الناس إلى التفكير في ديستوبيا حيث يتجاهل الذكاء الاصطناعي قيود السيطرة البشرية ويكتسب حياة خاصة به ، مثل فعل السايبورغ المدعوم بالذكاء الاصطناعي في "Terminator 2."

زاد رجل الأعمال إيلون ماسك والفيزيائي ستيفن هوكينغ ، الذي توفي عام 2018 ، من هذه المخاوف من خلال وصف صعود الذكاء الاصطناعي العام. كواحد من أعظم التهديدات لمستقبل البشرية.

لكن هذه المخاوف - على الأقل فيما يتعلق بالنماذج اللغوية الكبيرة - لا أساس لها من الصحة. ChatGPT والتقنيات المماثلة هي تطبيقات متطورة لإكمال الجمل - لاأكثر ولا أقل. استجاباتهم الخارقة هي دالة على مدى إمكانية التنبؤ بالبشر إذا كان لدى المرء ما يكفي من البيانات حول الطرق التي نتواصل بها.

على الرغم من اهتزاز روز بسبب تبادله مع سيدني ، إلا أنه كان يعلم أن المحادثة لم تكن نتيجة لعقل اصطناعي ناشئ. تعكس ردود سيدني مدى سمية بيانات التدريب الخاصة بها - بشكل أساسي مساحات كبيرة من الإنترنت - وليست دليلاً على التحركات الأولى ، على غرار فرانكشتاين ، للوحش الرقمي.

دفعت أفلام الخيال العلمي مثل "Terminator" الناس إلى افتراض أن الذكاء الاصطناعي سيأخذ حياة خاصة به قريبًا. يوشيكازو تسونو / وكالة الصحافة الفرنسية عبر Getty Images

قد تجتاز برامج الدردشة الجديدة امتداد اختبار تورينج، على اسم عالم الرياضيات البريطاني آلان تورينج ، الذي اقترح ذات مرة أنه يمكن القول إن الآلة "تفكر" إذا لم يستطع الإنسان تمييز ردود أفعالها عن ردود فعل إنسان آخر.

لكن هذا ليس دليلا على الإحساس. إنه مجرد دليل على أن اختبار تورينج ليس مفيدًا كما كان يُفترض سابقًا.

ومع ذلك ، أعتقد أن مسألة وعي الآلة هي خداع أحمر.

حتى لو أصبحت روبوتات المحادثة أكثر من مجرد آلات إكمال تلقائي رائعة - وهم بعيدون عنه - سيستغرق العلماء بعض الوقت لمعرفة ما إذا كانوا قد أصبحوا واعين. في الوقت الحالي أيها الفلاسفة لا يمكننا حتى الاتفاق حول كيفية تفسير الوعي البشري.

بالنسبة لي ، فإن السؤال الملح ليس ما إذا كانت الآلات حساسة ولكن لماذا يسهل علينا تخيل ذلك.

بعبارة أخرى ، تكمن المشكلة الحقيقية في السهولة التي يجسد بها الناس أو يعرضون السمات البشرية على تقنياتنا ، بدلاً من الشخصية الفعلية للآلات.

ميل إلى التجسيم

من السهل تخيل مستخدمي Bing الآخرين يسأل سيدني للحصول على التوجيه على قرارات حياتية مهمة وربما تطوير ارتباطات عاطفية بها. يمكن أن يبدأ المزيد من الأشخاص في التفكير في الروبوتات كأصدقاء أو حتى شركاء رومانسيين ، بنفس الطريقة التي وقع بها ثيودور تومبلي في حب سامانثا ، المساعد الافتراضي للذكاء الاصطناعي في فيلم سبايك جونونز "هدايا نسائية".

الناس ، بعد كل شيء ، مهيأة للتجسد البشري، أو ينسبون صفات بشرية إلى غير البشر. نحن اسم قواربنا و عواصف كبيرة؛ البعض منا يتحدث إلى حيواناتنا الأليفة ، ويخبر أنفسنا بذلك تحاكي حياتنا العاطفية حياتهم.

في اليابان ، حيث تُستخدم الروبوتات بانتظام لرعاية المسنين ، يصبح كبار السن مرتبطين بالآلات ، ينظرون إليهم أحيانًا على أنهم أطفالهم. ومن الصعب الخلط بين هذه الروبوتات والبشر ، فهم لا يشبهون الناس ولا يتحدثون.

ضع في اعتبارك مدى زيادة الميل والإغراء إلى التجسيم مع إدخال أنظمة تبدو وكأنها بشرية.

هذا الاحتمال قاب قوسين أو أدنى. يتم بالفعل استخدام نماذج اللغات الكبيرة مثل ChatGPT لتشغيل الروبوتات الشبيهة بالبشر ، مثل الروبوتات Ameca يجري تطويرها بواسطة Engineered Arts في المملكة المتحدة ، أجرى باباج مؤخرًا بودكاست تكنولوجي لشركة The Economist مقابلة مع Ameca يحركها ChatGPT. استجابات الروبوت ، رغم أنها متقطعة في بعض الأحيان ، كانت غريبة.

هل يمكن الوثوق بالشركات للقيام بالشيء الصحيح؟

يشير الميل إلى النظر إلى الآلات كأشخاص والتعلق بها ، جنبًا إلى جنب مع الآلات التي يتم تطويرها بسمات شبيهة بالبشر ، إلى مخاطر حقيقية للتشابك النفسي مع التكنولوجيا.

إن احتمالات الوقوع في حب الروبوتات أو الشعور بقرابة عميقة معها أو التلاعب بها سياسياً تتحقق بسرعة. أعتقد أن هذه الاتجاهات تسلط الضوء على الحاجة إلى حواجز حماية قوية للتأكد من أن التقنيات لن تصبح كارثية سياسياً ونفسياً.

لسوء الحظ ، لا يمكن دائمًا الوثوق بشركات التكنولوجيا لوضع مثل هذه الحواجز. لا يزال الكثير منهم يسترشدون بشعار مارك زوكربيرج الشهير يتحرك بسرعة وكسر الأشياء - توجيه بإصدار منتجات نصف مخبوزة والقلق بشأن الآثار المترتبة لاحقًا. في العقد الماضي ، شركات التكنولوجيا من Snapchat إلى Facebook وضعوا أرباحًا على الصحة العقلية من مستخدميها أو نزاهة الديمقراطيات حول العالم.

عندما تحقق كيفن روز مع Microsoft بشأن انهيار سيدني ، أخبرته الشركة أنه ببساطة استخدم الروبوت لفترة طويلة وأن التكنولوجيا أصبحت سطحية لأنها مصممة لتفاعلات أقصر.

وبالمثل ، فإن الرئيس التنفيذي لشركة OpenAI ، الشركة التي طورت ChatGPT ، في لحظة من الصدق المذهل ، حذر من ذلك "من الخطأ الاعتماد على [ذلك] في أي شيء مهم في الوقت الحالي ... لدينا الكثير من العمل للقيام به بشأن المتانة والصدق."

إذن كيف يكون من المنطقي إطلاق تقنية بمستوى جاذبية ChatGPT - إنه تطبيق المستهلك الأسرع نموًا على الإطلاق - عندما يكون غير جدير بالثقة ومتى يكون كذلك لا قدرة على التمييز حقيقة من الخيال؟

قد تكون النماذج اللغوية الكبيرة مفيدة كأدوات مساعدة للكتابة والترميز. من المحتمل أن يحدثوا ثورة في البحث على الإنترنت. وفي يوم من الأيام ، إذا تم دمجها بشكل مسؤول مع الروبوتات ، فقد يكون لها بعض الفوائد النفسية.

لكنها أيضًا تقنية مفترسة يمكن أن تستفيد بسهولة من الميل البشري لإبراز الشخصية على الأشياء - وهو ميل يتضخم عندما تحاكي تلك الأشياء سمات الإنسان بشكل فعال.![]()

نبذة عن الكاتب

نير إيزيكوفيتسأستاذ الفلسفة ومدير مركز الأخلاق التطبيقية ، [أومس] بوسطن

يتم إعادة نشر هذه المقالة من المحادثة تحت رخصة المشاع الإبداعي. إقرأ ال المقال الأصلي.